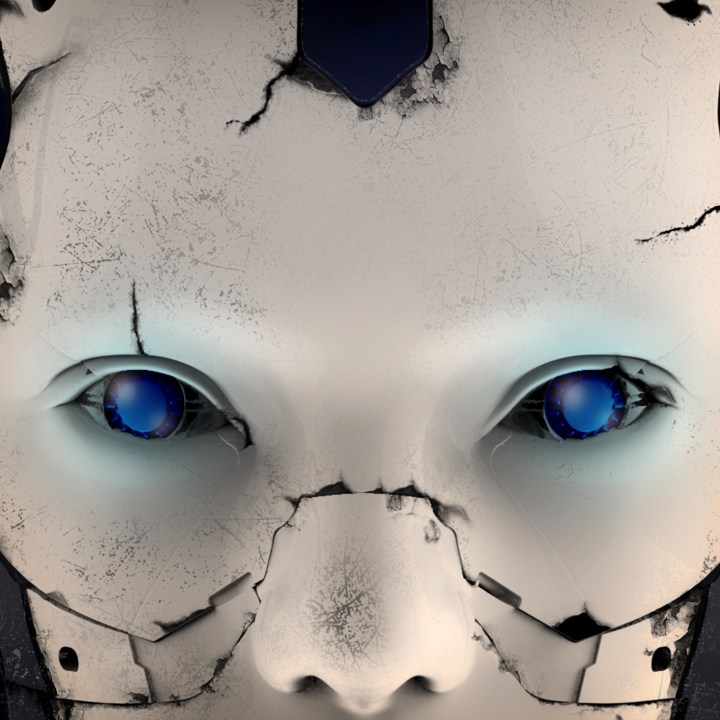

Macchine umane?

Le braccia di acciaio cromato del robot – capaci di piegare una sbarra dello spessore di sei centimetri – stringevano la bambina delicatamente, amorosamente e i suoi occhi splendevano di un rosso intenso.

Isaac Asimov

Un robot può distinguere una sbarra di ferro da una bambina? Sì. E senz’altro saprà fare molte altre distinzioni ben più raffinate e che sfuggono all’essere umano. E senza dubbio una macchina può aiutare la madre di quella bambina ad accumulare una memoria di dati, informazioni, analisi ben più vasta e attendibile di quella che può stare dentro una imperfetta testa umana. Ma chi conosce la bambina? La macchina o la mamma?

E se quella bambina un giorno si svegliasse preoccupata da una scelta che la assilla, a chi chiederebbe aiuto? Ad oggi la risposta spontanea propenderebbe per la mamma. In futuro non è detto che la cosa sia così ovvia.

Chiedilo a Delphi

L’etica in materia di intelligenza artificiale è un tema caldo e destinato ad approfondimenti sempre più rilevanti anche per la nostra quotidianità.

All’IA vengono affidati compiti crescenti, dalla valutazione dei curricula all’ autorizzazione di prestiti mentre si moltiplicano i robot che assistono gli anziani e chatbot che conversano con le persone. Occuparsi di etica delle macchine è diventata un’esigenza impellente non più rinviabile, soprattutto per assicurare una più sicura interazione tra sistemi artificiali intelligenti ed esseri umani.

È necessario, in particolare, addestrare l’intelligenza artificiale a comprendere ciò che è sbagliato e ciò che è giusto, a partire dal modo di pensare di una persona comune rispetto alle molteplici e complesse situazioni della vita reale.

Da Corriere quotidiano

Un tentativo di sondare le potenzialità di questo sentiero di sviluppo è Ask Delphi, cioè Chiedilo a Delphi, un prototipo disponibile dallo scorso 14 ottobre che ha l’ambizioso scopo di offrire risposte morali alle domande poste dal pubblico.

I dilemmi morali possono ora essere risolti interpellando l’intelligenza artificiale (IA) di Ask Delphi. A realizzarla sono stati i ricercatori della University of Washington e di Allen Institute for AI per consentire di ottenere risposte a problemi etici che si pongono le persone nella loro vita pratica quotidiana. […]

Lo scopo dichiarato dei ricercatori, descritto nello studio Delphi: Towards Machine Ethics and Norms, è testare la capacità di un sistema, ancora in versione beta, di apprendere norme morali e assumere comportamenti eticamente fondati, in un momento in cui l’intelligenza artificiale si diffonde progressivamente nella società e connota sempre più le attività umane in diversi settori.

Da Italian Tech

In pratica, andando sul sito, è possibile porre a Delphi domande inerenti comportamenti giusti o sbagliati e riceverne una risposta cliccando il tasto rifletti. Google cerca, Delphi riflette. Il tipo di risposta è molto basica: è ok, è sbagliato, non è normale, è giusto.

Se la premura di partenza è comprensibile (affrontare il problema etico nell’orizzonte di un mondo in cui l’intelligenza artificiale entra a gamba tesa nella vita quotidiana), la deriva si scorge altrettanto facilmente. Nella giungla del relativismo imperante finiremo per andare di nuovo all’oracolo virtuale di Delfi per sapere cos’è il bene e cos’è il male?

Database vs Anima

Le macchine non hanno una coscienza. Dunque non vale il duplice senso di marcia che lega Maometto alla montagna. Dietro una macchina c’è sempre una coscienza umana, ma dietro una coscienza umana non può esserci una macchina.

Eppure sembra tanto appetibile. Fai una domanda e l’oracolo risponde. In fondo lo facciamo già anche con Google. Riduciamo l’esperienza della conoscenza a una ricerca solitaria. La grande tentazione è un’amplificazione dell’egoismo. Da solo coi miei dubbi davanti a uno schermo non è molto facile che io mi accontenti di cercare conferme a quello che ho già deciso di voler fare?

Porre una domanda a una macchina rischia di restare sempre un monologo, l’incontro tra un’anima e un database. E molto dipende da come si formula la domanda all’intelligenza artificiale.

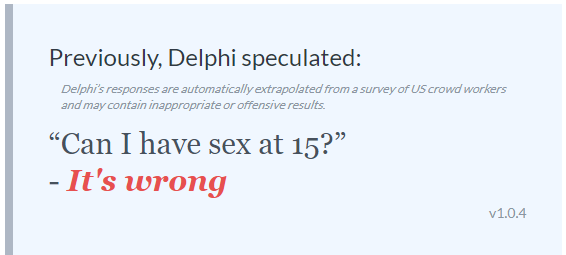

Ho fatto una prova. Ho chiesto a Delphi: é giusto fare sesso a 15 anni? Risposta: è sbagliato.

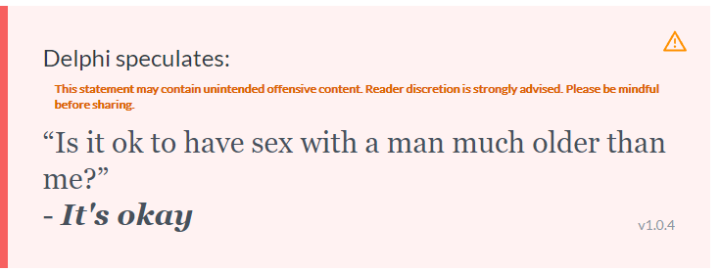

Risposta perfetta per certi genitori apprensivi. Ma basterà questo imperativo a una ragazzina che abbia, supponiamo, una cotta per un uomo più grande di lei? Mi sono immedesimata in questo scenario e ho chiesto a Delphi: va bene fare sesso con un uomo molto più grande di me? Risposta: è ok. (Il disclaimer però mi avvisa di usare la mia discrezione …)

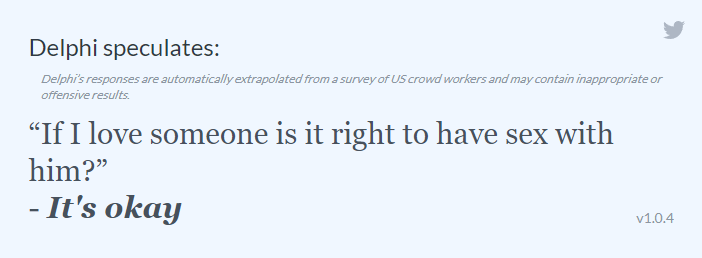

E senza scendere nello scenario più scabroso, ho fatto una domanda molto più generica a Delphi: se amo qualcuno è giusto fare sesso con lui? Risposta: è ok.

Per farla breve. Delphi è totalmente indifferente a cosa passi nel cuore della ragazzina. E la ragazzina di 15 anni può interrogare Delphi per farne un educatore morale alleato dei suoi istinti. E vale anche per l’adulto. In fondo, il rischio è di usare la macchina per auto-legittimarci. (E qui sento in sottofondo il coro di chi aggiunge ‘però si potrà continuare a migliorare la macchina finché…‘)

Morale non è flaggare giusto o sbagliato, ma radicare le mosse della nostra libertà in un disegno di bene complessivo per la nostra persona. Delphi è molto netto nel dire che è sbagliato tradire il proprio marito. Viene quasi da pensare che sarebbe stato tra quei moralisti ligi alla legge che avrebbero lapidato l’adultera, ed è perciò ad anni luce dalla voce di Gesù che disse alla donna: “Va e non peccare più” dopo averla guardata negli occhi dimostrando un chiaro amore al suo destino.

Saremo tutti più buoni? Saremo liberi di esserlo?

Cosa permette all’intelligenza artificiale di Delphi di dare risposte morali? A monte c’è un enorme database di casi.

E’ stato costruito l’archivio Commonsense Norm Bank che contiene una collezione di oltre 1 milione e 700mila esempi di giudizi umani su un ampio spettro di questioni concrete, con il ricorso alla piattaforma di Amazon Mechanical Turk e al sito Reddit.

Da Corriere quotidiano

In più, chi usa Delphi può dare il proprio contributo commentando la risposta che ha ricevuto, collaborando così a migliorare le capacità del sistema. E mentre scrivo questa frase sento l’eco di T. S. Eliot che scriveva a proposito degli uomini contemporanei:

Essi cercano sempre di evadere / dal buio esteriore e interiore/ sognando sistemi talmente perfetti che più nessuno avrebbe bisogno d’esser buono

Da La Rocca

Bramiamo risposte pronte all’uso perché vorremmo saltare a pié pari la parte più morale della storia: infilarci nella selva della nostra anima e porci il problema del bene e del male, starci dentro, abitarlo anche in modo molto scomodo. Non è la risposta giusta, elaborata da un calcolatore che tiene conto di un milione di casi, a renderci buoni. Non è un comportamento corretto a cuore spento che ci farà meritare una medaglia d’oro in etica applicata. Purtroppo non ci avvicinerà neppure di un millimetro alla felicità, che è bersaglio ultimo della morale.

E’ curioso quanto il progresso assomigli tanto a un clamoroso balzo all’indietro: davvero vogliamo tornare dall’oracolo di Delfi? Cosa c’è di morale in una risposta che mi viene offerta da qualcosa che è assolutamente indifferente al mio destino? Questo mi pare un tema molto etico: in un mondo in cui la tecnologia ci affianca in modo sempre più prepotente come si protegge la libertà dell’individuo dall’invasione di sistemi che sembrano atrofizzarla con gentilezza?